À l'ère des réseaux sociaux et de l'information instantanée, distinguer le vrai du faux est devenu un exercice quotidien. La désinformation scientifique — sur les vaccins, le climat, l'alimentation, la santé — prospère en exploitant nos biais cognitifs et notre méconnaissance de la méthode scientifique. Cet article explore les mécanismes de la désinformation et les outils que la démarche scientifique nous offre pour y résister.

Sommaire

La désinformation scientifique : un phénomène en expansion

La désinformation n'est pas un phénomène nouveau. De la théorie de la Terre plate aux remèdes miracles des charlatans du XIXe siècle, les fausses croyances ont toujours accompagné l'histoire humaine. Ce qui a changé, c'est la vitesse et l'échelle de diffusion. Une étude publiée dans Science par Vosoughi, Roy et Aral en 2018 a montré que sur Twitter, les fausses informations se propagent six fois plus vite que les informations vraies et touchent un public beaucoup plus large. La raison est neurologique autant que technologique.

Les fausses informations suscitent des réactions émotionnelles plus intenses — surprise, indignation, peur — que les informations exactes, généralement plus nuancées et moins sensationnelles. Or, les algorithmes des réseaux sociaux optimisent l'engagement, c'est-à-dire précisément les réactions émotionnelles. Le résultat est un écosystème informationnel qui favorise structurellement la propagation du faux au détriment du vrai.

Dans le domaine scientifique, la désinformation prend des formes particulièrement pernicieuses. Les mouvements anti-vaccination, qui ont contribué à la résurgence de la rougeole en Europe, s'appuient sur une étude frauduleuse de 1998 (rétractée depuis) et exploitent la méfiance naturelle envers les institutions. Le climatoscepticisme instrumentalise les incertitudes inhérentes à toute démarche scientifique pour nier un consensus solidement établi. Les pseudomédecines — homéopathie, naturopathie non fondée, « médecine quantique » — empruntent le vocabulaire scientifique pour se parer d'une légitimité qu'elles n'ont pas.

L'infodémie qui a accompagné la pandémie de COVID-19 a porté ces problèmes à un niveau sans précédent. Traitements inefficaces voire dangereux promus comme des panacées, théories complotistes sur l'origine du virus, méfiance envers les vaccins pourtant développés sur des bases scientifiques solides : la crise sanitaire a été doublée d'une crise de confiance dans la science, aux conséquences sanitaires directes et mesurables.

Le saviez-vous ? Selon une étude de l'IFOP en 2024, 21 % des Français croient que la Terre est plate ou ont des doutes sur sa forme sphérique. Ce chiffre, en augmentation chez les jeunes de 18-24 ans, illustre la progression des théories pseudo-scientifiques portées par les réseaux sociaux, en dépit de preuves scientifiques accumulées depuis plus de 2 000 ans.

Biais cognitifs : pourquoi notre cerveau nous trompe

Pour comprendre pourquoi la désinformation fonctionne si bien, il faut comprendre comment notre cerveau traite l'information. L'être humain n'est pas un évaluateur rationnel et impartial : il est équipé de raccourcis cognitifs — les heuristiques — qui, s'ils sont généralement efficaces au quotidien, peuvent être exploités par la désinformation.

Le biais de confirmation est le plus fondamental et le plus documenté de ces biais. Nous avons une tendance naturelle à rechercher, interpréter et mémoriser les informations qui confirment nos croyances existantes, tout en ignorant ou disqualifiant celles qui les contredisent. Ce biais ne touche pas seulement les personnes peu éduquées : des études ont montré que les individus très diplômés sont parfois encore plus habiles à trouver des arguments en faveur de leurs croyances préexistantes, une compétence qui peut être mise au service du raisonnement motivé plutôt que de la recherche de vérité.

L'effet de vérité illusoire (illusory truth effect) montre que la simple répétition d'une affirmation augmente sa crédibilité perçue, indépendamment de sa véracité. Ce mécanisme, mis en évidence par les psychologues Hasher, Goldstein et Toppino en 1977, explique l'efficacité de la propagande par la répétition et des campagnes de désinformation qui martèlent les mêmes messages. Le cerveau confond la familiarité avec la vérité : « Si j'ai déjà entendu cette affirmation, elle doit être vraie. »

Le biais de proportionnalité nous pousse à chercher des causes à la hauteur des effets observés. Un événement majeur (pandémie mondiale, assassinat d'un président, accident d'avion) « mérite » une explication également spectaculaire, ce qui rend les théories du complot plus satisfaisantes psychologiquement que les explications prosaïques. Le fait qu'un virus puisse émerger naturellement d'un marché animalier semble « insuffisant » pour expliquer une pandémie mondiale, ouvrant la porte aux théories de manipulation délibérée.

L'effet Dunning-Kruger et la confiance injustifiée

L'effet Dunning-Kruger, démontré en 1999 par les psychologues David Dunning et Justin Kruger, décrit un phénomène particulièrement pertinent pour la désinformation scientifique : les personnes les moins compétentes dans un domaine ont tendance à surestimer leurs compétences, tandis que les experts ont tendance à sous-estimer les leurs. Un novice en virologie qui a lu quelques articles sur internet peut être convaincu d'en savoir plus que les virologues professionnels, précisément parce qu'il ignore l'étendue de ce qu'il ignore.

Ce biais est amplifié par l'accès universel à l'information. La disponibilité d'articles scientifiques en libre accès, si elle est une avancée démocratique, crée l'illusion que la simple lecture d'un article suffit à le comprendre. Or, évaluer correctement une étude scientifique nécessite des compétences méthodologiques qui s'acquièrent par des années de formation : comprendre la conception expérimentale, identifier les biais statistiques, évaluer la taille des effets, replacer les résultats dans le contexte de la littérature existante.

La méthode scientifique comme rempart

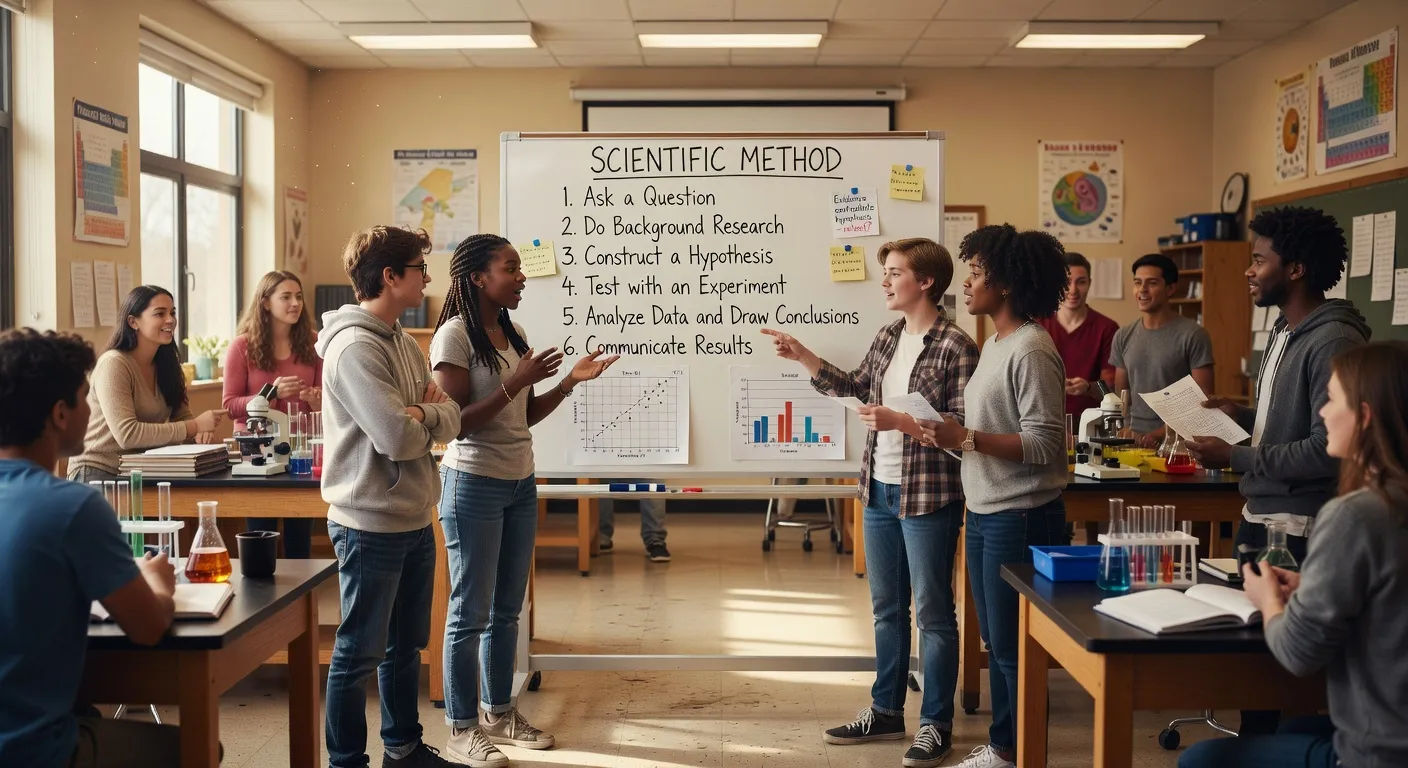

Face à la désinformation, la méthode scientifique offre un cadre rigoureux pour évaluer les affirmations. Non pas qu'elle soit parfaite — les scientifiques eux-mêmes sont sujets aux biais — mais elle intègre des mécanismes correcteurs qui, sur le long terme, permettent de converger vers des descriptions de plus en plus fiables de la réalité.

Le premier pilier est la reproductibilité. Un résultat scientifique n'est considéré comme fiable que s'il peut être reproduit par d'autres équipes, dans d'autres laboratoires, avec des méthodes indépendantes. Cette exigence est le meilleur antidote contre les résultats erronés, qu'ils soient dus à des erreurs méthodologiques, des biais ou une fraude délibérée. La « crise de la reproductibilité » qui secoue certaines disciplines (psychologie, biomédecine) depuis les années 2010 n'est pas un échec de la science, mais au contraire une démonstration de sa capacité d'autocorrection.

Le deuxième pilier est la revue par les pairs (peer review). Avant d'être publiée dans une revue scientifique réputée, une étude est évaluée par plusieurs experts indépendants du même domaine qui vérifient la méthodologie, l'analyse statistique et la validité des conclusions. Ce filtre, bien qu'imparfait (certaines études frauduleuses ou erronées passent à travers), élimine la grande majorité des travaux de mauvaise qualité. C'est pourquoi la distinction entre un article publié dans Nature ou The Lancet et un article publié sur un blog personnel est fondamentale.

Le troisième pilier est la falsifiabilité, concept introduit par le philosophe Karl Popper. Une théorie scientifique doit faire des prédictions qui pourraient, en principe, être réfutées par l'observation ou l'expérience. Si une théorie est formulée de manière à être compatible avec n'importe quel résultat possible, elle n'est pas scientifique. Ce critère permet de distinguer les théories scientifiques (évolution, relativité, tectonique des plaques) des pseudosciences (astrologie, homéopathie) dont les affirmations sont systématiquement reformulées pour échapper à la réfutation.

Enfin, le consensus scientifique — l'accord de la grande majorité des experts d'un domaine — est un indicateur de fiabilité, bien qu'il ne soit pas infaillible. Quand 97 % des climatologues s'accordent sur la réalité du réchauffement climatique d'origine humaine, ou quand les académies des sciences du monde entier confirment la sécurité et l'efficacité des vaccins, le poids des preuves est considérable. Remettre en question un consensus scientifique est tout à fait légitime, mais cela exige des preuves au moins aussi solides que celles qui le fondent.

Outils concrets de vérification

L'esprit critique ne se limite pas à une attitude intellectuelle : il s'outille. Plusieurs méthodes et ressources, accessibles à tous, permettent de vérifier la fiabilité d'une information avant de la partager ou d'agir en conséquence.

La méthode SIFT, développée par Mike Caulfield, propose quatre étapes rapides : Stop (ne pas réagir immédiatement), Investigate the source (vérifier qui est l'auteur et quel est son expertise), Find better coverage (chercher si d'autres sources fiables rapportent la même information), Trace claims to the original context (remonter à la source primaire). Cette méthode, applicable en quelques minutes, filtre la majorité des fausses informations courantes.

Pour les affirmations de santé, la consultation de PubMed (base de données de la littérature biomédicale) ou de Cochrane (méta-analyses systématiques) permet de vérifier si une affirmation est soutenue par des données cliniques de qualité. Les résumés des revues Cochrane, rédigés en langage accessible, sont particulièrement utiles pour le grand public.

Les sites de fact-checking professionnels — AFP Factuel, Les Décodeurs (Le Monde), CheckNews (Libération), Hoaxbuster — vérifient quotidiennement les rumeurs et fausses informations les plus virales. Leur méthodologie est transparente et leurs corrections sont sourcées. Ils constituent une première ligne de défense efficace contre la désinformation courante. Suivre l'actualité via des médias fiables est également essentiel pour cultiver un environnement informationnel sain.

La recherche inversée d'images (Google Images, TinEye) permet de vérifier l'authenticité et le contexte d'une photo. De nombreuses fausses informations utilisent des images réelles mais sorties de leur contexte ou datant d'un autre événement. En quelques clics, on peut retrouver l'origine d'une photo et vérifier si son utilisation actuelle est légitime.

En Drôme. Plusieurs bibliothèques municipales et médiathèques de la Drôme (Valence, Montélimar, Romans-sur-Isère) proposent des ateliers d'éducation aux médias et à l'information (EMI) destinés aux adultes et aux adolescents. Ces ateliers gratuits apprennent à identifier les sources fiables, à détecter les manipulations visuelles et à utiliser les outils de vérification. Renseignez-vous auprès de votre bibliothèque locale.

Intelligence artificielle et nouvelles formes de désinformation

L'émergence de l'intelligence artificielle générative — ChatGPT, Midjourney, Sora — ouvre un nouveau chapitre dans l'histoire de la désinformation. La capacité de produire des textes, des images, des vidéos et des voix synthétiques d'un réalisme saisissant multiplie les possibilités de manipulation tout en rendant la détection plus difficile.

Les deepfakes — vidéos ou images réalistes générées par IA — posent des défis inédits. En 2024, des deepfakes de dirigeants politiques ont circulé massivement pendant plusieurs cycles électoraux, brouillant la frontière entre le réel et le fabriqué. La technologie évolue plus vite que les outils de détection : si les premiers deepfakes de 2017 étaient relativement faciles à identifier, les versions actuelles trompent souvent l'œil humain non entraîné.

Les textes générés par IA peuvent produire des articles de désinformation à une échelle industrielle. Des « fermes à contenu » utilisent des modèles de langage pour créer des centaines de sites web imitant des médias légitimes, diffusant de la désinformation sur la santé, la politique ou l'environnement. La qualité linguistique de ces textes les rend difficiles à distinguer d'articles écrits par des humains, contrairement aux anciennes « fake news » souvent truffées de fautes d'orthographe.

Face à ces menaces, la recherche en intelligence artificielle développe aussi des outils de défense : algorithmes de détection des deepfakes basés sur l'analyse de micro-expressions faciales, systèmes de traçabilité du contenu par filigrane numérique (watermarking), classificateurs de texte capables d'identifier le style statistique des modèles de langage. La course entre création et détection de contenu trompeur est lancée, et son issue dépendra autant des avancées technologiques que des politiques de régulation.

Éduquer à l'esprit critique : enjeux et initiatives

La solution à long terme contre la désinformation ne réside pas uniquement dans la technologie ou la régulation, mais dans l'éducation. Former des citoyens capables d'évaluer la qualité de l'information qu'ils consomment est un investissement dont les bénéfices dépassent largement la seule question des fake news : l'esprit critique est une compétence transversale qui enrichit tous les aspects de la vie personnelle et professionnelle.

En France, l'éducation aux médias et à l'information (EMI) est inscrite dans les programmes scolaires depuis 2015, mais sa mise en œuvre reste hétérogène. Le manque de formation spécifique des enseignants, le temps limité disponible dans les emplois du temps et l'absence de méthodes pédagogiques standardisées sont autant de freins identifiés par les évaluations institutionnelles.

Des initiatives comme La main à la pâte, fondation créée par le prix Nobel de physique Georges Charpak, promeuvent l'enseignement des sciences fondé sur l'investigation dès l'école primaire. L'idée est de faire vivre aux élèves la démarche scientifique — formuler des hypothèses, concevoir des expériences, analyser des résultats, argumenter — plutôt que de leur transmettre des connaissances de manière descendante. Les études d'évaluation montrent que les élèves ayant bénéficié de ces approches développent une meilleure capacité à distinguer les affirmations fondées des affirmations infondées.

Les chaînes de vulgarisation scientifique sur YouTube et les podcasts jouent également un rôle croissant dans l'éducation à l'esprit critique. Des vulgarisateurs comme Hygiène Mentale (dédié aux biais cognitifs et à la zététique), Defakator (debunking de fausses informations) ou La Tronche en Biais (pensée critique) touchent des millions de personnes et contribuent à diffuser une culture du doute raisonné.

La zététique, parfois appelée « art du doute », propose un cadre méthodologique structuré pour évaluer les affirmations extraordinaires. Née dans les années 1990 à l'Université de Nice sous l'impulsion d'Henri Broch, elle enseigne les principes du rasoir d'Ockham (préférer l'explication la plus simple), de la charge de la preuve (c'est à celui qui affirme de prouver) et de l'évaluation des témoignages (la fiabilité de la mémoire humaine, les biais de perception). Ces principes, bien que simples, constituent un kit de survie intellectuelle d'une redoutable efficacité.

Le saviez-vous ? L'approche la plus efficace pour corriger une fausse croyance n'est pas la confrontation directe (qui provoque souvent un « effet boomerang » renforçant la croyance), mais le « debunking préventif » ou « inoculation ». En exposant les gens aux techniques de manipulation AVANT qu'ils ne rencontrent la désinformation — comme un vaccin cognitif —, on réduit significativement leur susceptibilité. Le jeu en ligne « Bad News », basé sur ce principe, a prouvé son efficacité dans des études contrôlées.

L'enjeu est considérable. Dans une démocratie, la qualité des décisions collectives dépend directement de la qualité de l'information sur laquelle elles se fondent. Sur les questions scientifiques — changement climatique, vaccination, transition énergétique, intelligence artificielle — des choix politiques majeurs sont en jeu, et ils ne peuvent être éclairés que par une population informée, capable de distinguer le savoir scientifique de l'opinion, le consensus de la controverse manufacturée, la preuve de l'anecdote. Former à l'esprit critique n'est pas un luxe intellectuel, c'est une nécessité démocratique.